Und es gibt seltene Augenblicke, in denen sich unser Verständnis vom Spiel selbst verschiebt.

Der 5. Dezember 2017 war ein solcher Moment.

Als DeepMind die Ergebnisse von AlphaZero veröffentlichte, ging es vordergründig um 100 Partien gegen Stockfish 8 – den TCEC-Weltmeister vom Dezember 2016 und die damals stärkste frei verfügbare Engine der Welt. Doch in Wahrheit ging es um etwas anderes: um die Frage, ob Schach eine Ansammlung von Regeln ist, die man immer schneller berechnen muss – oder ein System von Mustern, das man lernen kann.

Stockfish war das Produkt von Jahrzehnten kollektiver Arbeit. Jede Bewertungsfunktion, jede Heuristik, jede Suchoptimierung trug menschliches Schachwissen in sich. AlphaZero hatte nichts davon. Keine einzige Großmeisterpartie. Kein einziges fest einprogrammiertes Positionskriterium. Nur die Regeln – und die Fähigkeit, aus Erfahrung zu lernen.

Vier Stunden bis zur Weltklasse

Die Trainingskurve wirkt bis heute surreal. Nach wenigen Stunden Selbstspiel erreichte AlphaZero ein Niveau oberhalb von Stockfish. Nicht, weil es mehr rechnete – sondern weil es anders suchte.

Klassische Engines arbeiten nach einem klaren Prinzip: möglichst viele Varianten möglichst tief berechnen und mit einer fein abgestimmten Bewertungsfunktion vergleichen. Die Qualität der Bewertung ist entscheidend, aber die Menge der analysierten Stellungen war lange der wichtigste Faktor.

AlphaZero stellte dieses Verhältnis auf den Kopf. Es berechnete nicht mehr – es wählte besser aus. Statt rund 70 Millionen Stellungen pro Sekunde nur etwa 80.000 – aber fast ausschließlich solche, die strategisch relevant waren.

Zum ersten Mal entstand der Eindruck, dass eine Engine nicht nur brute force spielt, sondern Ideen verfolgt.

Wie sich das auf dem Brett zeigte

Die Partien wirken beim Nachspielen nicht spektakulär im klassischen Sinne. Es sind keine wilden Mattangriffe, keine forcierten Taktikgewitter. Die Revolution ist leiser – und gerade deshalb so tiefgreifend.

Typisch sind langfristige Qualitätsopfer in scheinbar ruhigen Stellungen. Nicht als taktisches Motiv, sondern als strukturelle Entscheidung. Turm gegen Läufer oder Springer – und dafür Felder, Linien und dauerhafte Initiative. AlphaZero zeigte, dass Kompensation nicht nur eine kurzfristige Rechenfrage ist, sondern ein langfristiger strategischer Zustand.

Ebenso auffällig ist der Umgang mit Bauernzügen am Rand. Früh gespielte a- und h-Bauern, nicht als primitive Angriffshebel, sondern zur Raumkontrolle, zur Verhinderung gegnerischer Springermanöver oder zur Vorbereitung langfristiger Figurenwege. Viele dieser Züge wären früher im Vereinsabend mit „unnötig“ kommentiert worden – heute kennen wir ihren Wert sehr viel besser.

Und dann die Königszüge. Märsche ins Zentrum im Mittelspiel, lange bevor ein klassisches Endspiel erreicht ist. Nicht aus Abenteuerlust, sondern weil die Stellung es erlaubt. Aktivität wird zum höchsten Wert – Material zur Nebenbedingung.

Viele Großmeister beschrieben diese Partien als positionsorientiertes Schach in seiner reinsten Form. Nicht romantisch, nicht spekulativ – sondern vollständig durchgerechnet, nur auf einer anderen Ebene.

Das Match im Kontext – spektakulär, aber nicht „neutral“

Die nackten Zahlen sind bekannt: 100 Partien, 28 Siege für AlphaZero, 72 Remis, keine einzige Niederlage.

Gleichzeitig war die Veröffentlichung von Anfang an umstritten – nicht wegen der Stärke von AlphaZero, sondern wegen der Vergleichbarkeit der Bedingungen. Stockfish spielte ohne Eröffnungsbuch, ohne Endspieldatenbanken, mit fester Zeit pro Zug und in einer Konfiguration, die in dieser Form nicht als Standard für faire Turniertests galt. Mehrere Entwickler und Kommentatoren verwiesen darauf, dass Stockfish gerade beim Zeitmanagement unter „1 Minute pro Zug fix“ einen Teil seiner Stärke nicht ausspielen konnte.

Das ist wichtig zu erwähnen, weil es den historischen Moment sauber einordnet: Das Match war kein endgültiger „Wer-ist-stärker-für-immer“-Beweis. Es war ein Demonstrationsexperiment – und als solches ein sehr starkes.

Selbst wenn man das Ergebnis relativiert, bleibt die zentrale Erkenntnis bestehen: Ein System ohne menschliches Schachwissen konnte innerhalb weniger Stunden das Niveau einer Weltklasse-Engine erreichen, in der Jahrzehnte an Entwicklung steckten.

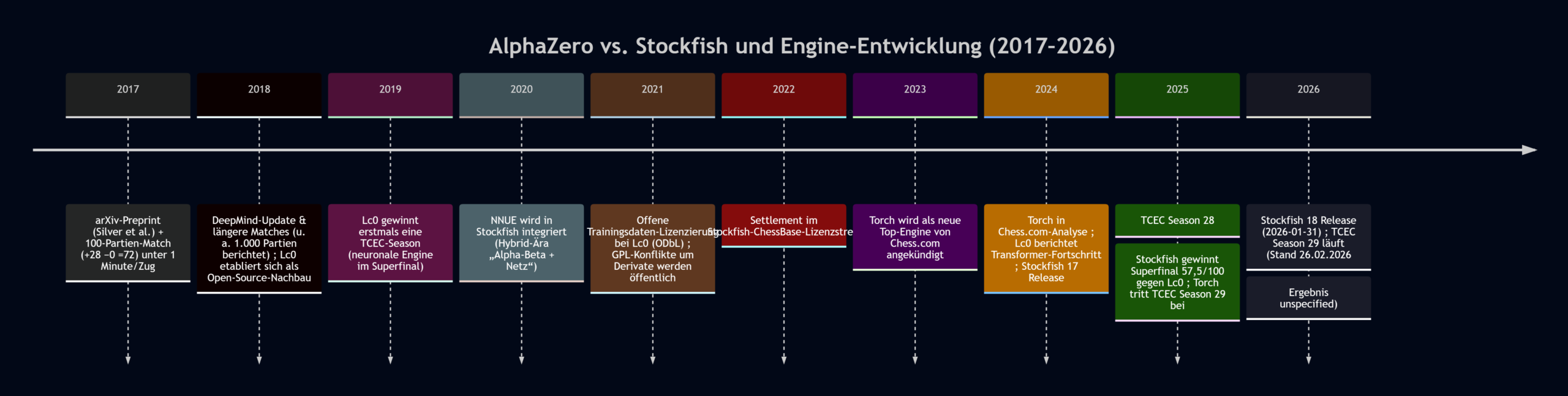

Zeitleiste: Von AlphaZero zum modernen Engine-Zeitalter

Wer den Einfluss von AlphaZero wirklich verstehen will, sollte nicht nur auf das 100-Partien-Match schauen, sondern auf die Jahre danach. Die eigentliche Revolution bestand nicht darin, dass eine Engine eine andere schlug – sondern darin, wie schnell sich die gesamte Engine-Landschaft veränderte: Open-Source-Nachbauten, neuronale Netze in klassischen Engines, neue Top-Engines, Lizenzfragen und eine völlig neue Art, Schachsoftware zu entwickeln.

Die folgende Zeitleiste fasst diese Entwicklung von der Veröffentlichung des DeepMind-Papers bis zur modernen Hybrid-Ära zusammen:

Die Partien zum Nachspielen

Ein großer Teil der Faszination entsteht erst beim Nachspielen. Wer die AlphaZero-Partien nur als Ergebnisliste liest, verpasst das Entscheidende: den Stil. In den veröffentlichten Beispielpartien aus dem DeepMind-Paper sieht man genau jene Motive, die später so oft diskutiert wurden – langfristige Kompensation, Initiative, Figurenkoordination und ein sehr freier Umgang mit Material, wenn dafür Felder und Aktivität gewonnen werden.

Unten findest du alle 10 veröffentlichten Partien. Zusätzlich bleibt der Direktdownload der Gesamtdatei erhalten.

➡ PGN: AlphaZero vs. Stockfish (alle Partien) herunterladen

Partie 1: Spanisch (Berlin-Struktur mit d3) – Stockfish 8 vs. AlphaZero (0–1)

Partie 2: Spanisch (Berlin-Struktur, c3/d4-Ideen) – Stockfish 8 vs. AlphaZero (0–1)

Partie 3: Englisch/Réti-Struktur – AlphaZero vs. Stockfish 8 (1–0)

Partie 4: Französisch (Vorstoß) – AlphaZero vs. Stockfish 8 (1–0)

Partie 5: Indische Fianchetto-Struktur (d5 / Nh4–f5) – AlphaZero vs. Stockfish 8 (1–0)

Partie 6: Indische Fianchetto-Struktur (Variante mit frühem …Qxc3) – AlphaZero vs. Stockfish 8 (1–0)

Partie 7: Damenbauernspiel / Fianchetto mit b4-b5 – AlphaZero vs. Stockfish 8 (1–0)

Partie 8: Damenbauernspiel / Fianchetto mit frühem e4-e5 – AlphaZero vs. Stockfish 8 (1–0)

Partie 9: Französisch (Vorstoß, scharfe Struktur) – AlphaZero vs. Stockfish 8 (1–0)

Partie 10: Réti/Englisch-Fianchetto – AlphaZero vs. Stockfish 8 (1–0)

Tipp für den Vereinsabend: Lass zuerst eine Partie ohne Enginekommentar durchlaufen und stoppe an den Stellen, an denen ein Materialopfer oder ein „komischer“ Bauernzug erscheint. Erst danach mit Stockfish/Lc0 nachanalysieren. Genau dort wird der Stilunterschied zu klassischen Engine-Erwartungen am deutlichsten.

Wer die Partien analysiert, sollte bewusst darauf achten, nicht nur nach Taktikfehlern zu suchen. Spannender ist die Frage: Wann akzeptiert AlphaZero materiellen Nachteil – und wofür? Genau dort beginnt der Lernwert.

Warum AlphaZero nie in der TCEC spielte

AlphaZero war kein Turnierprogramm. Es war ein Forschungsprojekt. Der Code wurde nicht veröffentlicht, die Hardwareanforderungen waren enorm, und DeepMind verfolgte andere Ziele als den klassischen Engine-Wettbewerb.

AlphaZero sollte nicht die TCEC dominieren. Es sollte zeigen, dass ein allgemeiner Lernansatz in hochkomplexen Strategiespielen funktioniert. In diesem Sinne war das Projekt weniger „neue Engine“ als „neuer Beweis“.

Leela Chess Zero – als die Community die Idee frei machte

Und genau hier begann die zweite Hälfte der Geschichte. Weil AlphaZero selbst nicht verfügbar war, entstand mit Leela Chess Zero (Lc0) ein Open-Source-Projekt, das denselben Grundgedanken praktisch umsetzte: neuronales Netz, Monte-Carlo-Baumsuche, Training durch verteiltes Selbstspiel.

Lc0 war damit nicht einfach ein Nachbau, sondern die Öffnung einer Idee. Plötzlich konnte die Schachwelt selbst erleben, wie sich ein „AlphaZero-artiger“ Stil entwickelt, wie Netze trainiert werden, wie sich Suchparameter auswirken und wie neuronale Engines in echten Turnierumgebungen performen.

Vor allem brachte Lc0 etwas zurück ins Computerschach, das fast verloren gegangen war: echte stilistische Unterschiede auf absolutem Spitzenniveau. Wer Stockfish und Lc0 parallel auf dieselbe Stellung ansetzt, bekommt oft nicht nur zwei Bewertungen, sondern zwei unterschiedliche strategische Erzählungen.

Die stille Revolution: NNUE und die Rückkehr von Stockfish

Die vielleicht wichtigste Folge von AlphaZero war ausgerechnet eine, die nicht bei den neuronalen Engines selbst begann. Klassische Engines – allen voran Stockfish – integrierten neuronale Bewertungsfunktionen über NNUE. Dadurch bekam die klassische Alpha-Beta-Suche ein trainiertes, deutlich feineres Positionsverständnis.

Das Ergebnis ist historisch bemerkenswert: Nicht „neu“ besiegt „alt“, sondern beide Ansätze verschmelzen. Der moderne Stockfish ist keine klassische Engine im alten Sinn mehr, sondern ein Hybrid aus extrem starker Suche und gelernter Bewertung.

Deshalb ist die Rückkehr Stockfishs an die Spitze vieler Ranglisten kein Widerlegen von AlphaZero – sondern eher der sichtbarste Beleg für dessen Einfluss.

Einfluss auf Eröffnungstheorie und praktische Analyse

Wer in den letzten Jahren Eröffnungstheorie verfolgt hat, kennt das Muster: Varianten, die lange als harmlos galten, werden plötzlich dynamisch spielbar. Positionen, die frühere Engines „trocken ausgleichen“, enthalten bei genauerem Hinsehen langfristige Initiative, bessere Felder oder ungünstige Figurenkoordination.

Besonders verändert hat sich der Blick auf Kompensation. Früher wurde sie oft als Taktikfrage verstanden: Reicht das konkret? Heute wird sie deutlich häufiger als Positionsfrage bewertet: Welche Figur bleibt schlecht? Welche Linie bleibt offen? Welcher Hebel ist dauerhaft vorbereitet?

Das ist auch für Vereinsspieler relevant. Moderne Engineanalyse hilft nicht nur, Fehler zu vermeiden – sie hilft, Pläne zu erkennen. Und genau darin liegt ihr größter Trainingswert.

Was wir als Spieler daraus lernen können

Ein häufiger Fehler in der Engine-Nutzung ist der Versuch, nur „den besten Zug“ zu kopieren. Gerade bei AlphaZero/Lc0-artigen Ideen funktioniert das schlecht, weil der Sinn eines Zuges oft erst viele Züge später sichtbar wird.

Viel hilfreicher ist ein anderer Ansatz:

Welche Felder will die Engine kontrollieren?

Welche gegnerische Figur wird schleichend verschlechtert?

Warum ist Material hier zweitrangig?

Welcher Hebel wird vorbereitet, obwohl noch gar nichts „droht“?

Wer so analysiert, lernt nicht nur Varianten, sondern Schachdenken.

Die andere Seite der Revolution: Lizenzstreit, Derivate und GPL

Die Post-AlphaZero-Ära brachte nicht nur neue Ideen, sondern auch neue Konflikte. Mit dem Boom neuronaler Netze, Engine-Derivaten und „neuen“ kommerziellen Produkten wurde die Frage immer wichtiger, woher Code stammt – und unter welchen Bedingungen er genutzt werden darf.

Stockfish ist freie Software unter der GPL (GNU General Public License). Diese Lizenz erlaubt die Nutzung und Weiterentwicklung ausdrücklich – aber nur unter klaren Bedingungen. Wer GPL-Code verwendet oder ableitet, muss die Lizenzbedingungen einhalten, insbesondere die Offenlegung des entsprechenden Quellcodes und die korrekte Weitergabe der Lizenzinformationen.

Genau daran entzündete sich in den 2020er-Jahren ein prominenter Streit zwischen dem Stockfish-Projekt und ChessBase im Kontext von Engine-Produkten wie „Fat Fritz 2“ sowie früheren Compliance-Fragen rund um Derivate. Der Fall war deshalb so wichtig, weil es nicht nur um eine einzelne Engine ging, sondern um ein Grundprinzip der Computerschachszene: Was als „neues Produkt“ verkauft wird, muss lizenzrechtlich sauber sein – gerade dann, wenn Open-Source-Arbeit im Hintergrund steckt.

Der Konflikt endete nicht als Randnotiz, sondern als starkes Signal: In der modernen Engine-Welt sind nicht nur Elo und Architektur entscheidend, sondern auch Transparenz, Herkunft des Codes und korrekte Lizenzpraxis. Für die Community war das ein Präzedenzfall – und für viele Nutzer ein Anlass, sich erstmals mit GPL überhaupt zu beschäftigen.

Ein neuer Begriff von „Verständnis“

Über Jahrzehnte galt die Vorstellung, dass Maschinen zwar rechnen, aber nicht verstehen. AlphaZero hat dieses Bild nicht einfach widerlegt – es hat gezeigt, dass wir „Verständnis“ im Schach vielleicht zu eng definiert hatten.

Wenn ein System zuverlässig langfristige Kompensation erkennt, Figuren verbessert, den richtigen Moment für strukturelle Opfer findet und über Dutzende Züge einen Plan verfolgt – was genau fehlt dann noch zum Begriff „Verstehen“?

Vielleicht ist die sauberste Antwort: Verständnis ist im Schach kein mystischer Zustand, sondern ein trainiertes Bewertungsmuster. Und genau dieses Muster können Maschinen heute auf höchstem Niveau bilden.

Rückblick: Warum dieses Match historisch bleibt

Heute führt Stockfish wieder viele Ranglisten an. Lc0 gehört weiterhin zur Weltspitze. Neue Engines wie Torch haben zusätzliche Dynamik in die Topturniere gebracht. Die Engine-Landschaft ist breiter, stärker und technischer geworden.

Und doch führt eine Linie zurück zu diesem Dezembermoment 2017.

Ohne AlphaZero gäbe es kein Lc0 in seiner heutigen Form.

Ohne AlphaZero gäbe es kein NNUE-Stockfish in dieser Form.

Ohne AlphaZero sähe moderne Engineanalyse in Verein, Turniervorbereitung und Großmeisterpraxis anders aus.

Der historische Kern sind nicht die 28 Siege.

Es ist die Erkenntnis, dass Schach nicht nur berechnet werden kann – sondern gelernt.

Und dass Maschinen uns dabei nicht nur schlagen, sondern das Spiel selbst neu zeigen können.

Quellen & weiterführende Links

Primärquellen / AlphaZero (DeepMind)

- arXiv: Mastering Chess and Shogi by Self-Play with a General Reinforcement Learning Algorithm (Abstract)

- arXiv-PDF (DeepMind Paper, 05.12.2017)

- DeepMind Blog: AlphaZero – shedding new light on chess, shogi and go

Stockfish (offiziell)

- Stockfish – offizielle Website

- Stockfish auf GitHub

- Stockfish Releases (GitHub)

- Stockfish 18 Release (offizieller Blogpost)

Leela Chess Zero (offiziell)

- Leela Chess Zero – Website

- Lc0 auf GitHub

- Lc0 Projekt-Überblick

- Lc0 Download

- Lc0 Networks / Netzdateien

- Lc0 Blog: Transformer Progress

- Lc0 Blog: The Importance of Open Data

PGN-Archive / Turnierdaten

Turnierberichte & Engine-Szene (TCEC / CCC / Torch)

- Chessdom: Stockfish gewinnt TCEC Superfinal

- Chessdom: Torch enters TCEC Season 29

- Chess.com / CCC (Andrew Grant): CCC25 Rapid

- Chess.com: Torch chess engine

- Chess.com: Torch in der Analyse verfügbar

Deutschsprachige Einordnung / Berichte

- ChessBase DE: AlphaZero-Partien unter der Lupe

- ChessBase DE: Wie Stockfish AlphaZero ins neuronale Netz ging

- Deutscher Schachbund: AlphaZero schlägt Stockfish

- Spektrum: AlphaZero schlägt weltbesten Schachcomputer

Lizenzstreit / GPL-Kontext

Kommentar hinterlassen